- Servicios

- Evaluaciones

- NIST AI RMF

Prueba tu madurez en gestión del riesgo de IA con la evaluación del NIST AI RMF

- Services

- Assessments

- NIST AI RMF

Prueba tu madurez en gestión del riesgo de IA con la evaluación del NIST AI RMF

Beneficios de la evaluación del

NIST AI RMF

Beneficios de la evaluación del

NIST AI RMF

Demuestra que cumples con el estándar más reconocido para la gestión de riesgos de IA.

Asegura una IA responsable y obtén contratos que exigen gobernanza.

La ISO 42001 valida tu SGIA; el NIST AI RMF muestra cómo gestionas tus riesgos.

Evita costes de cumplimiento alineándote con el EU AI Act y las regulaciones de EE. UU.

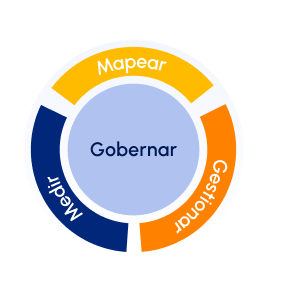

Nuestra herramienta de evaluación

Nuestra herramienta de evaluación

Supervisa el progreso

en todas las funciones del NIST AI RMF

Recopila evidencias

sobre cómo se ha evaluado el cumplimiento

Muestra dónde estás

destacando fortalezas, brechas y áreas de mejora

Proceso de Evaluación

Kick-off

Identificamos tus casos de uso y las áreas de riesgo asociadas.

Evaluación

Tu organización completa el checklist del NIST con evidencias.

Revisión

Zertia valida las respuestas y calcula los niveles de cumplimiento.

Atestación

Emitimos un informe de conformidad que indica tu nivel de alineación con el NIST AI RMF.

A quién va dirigido

Organizaciones que necesitan demostrar gobernanza en IA.

Empresas que adoptan ISO 42001 y buscan marcos complementarios.

Proveedores tecnológicos que necesitan demostrar confianza.

Equipos legales y de riesgos que necesitan demostrar IA responsable.

¿Por qué Zertia?

Acceso a una plataforma que hace que la evaluación sea estructurada, transparente y fácil de completar.

Experiencia en la ISO 42001 y el EU AI Act, garantizando alineación con las mejores prácticas internacionales.

Ofrecemos una evaluación imparcial, totalmente separada de cualquier actividad de implementación o consultoría.

Recursos

No Time to Test: The High-Speed Collapse of AI Safety Standards

In recent months, OpenAI and its competitors have slashed the time spent testing the safety of their most powerful AI models. Where GPT-4 underwent six months of evaluations, its successor is getting less than a week. The rationale? Competitive pressure and the race for dominance—particularly against China. This acceleration has not gone unnoticed. Internal testers, former staff, and AI researchers alike have sounded the alarm: as model capabilities increase, so does the risk of misuse. Yet the resources devoted to safety are shrinking, not growing. As one current evaluator put it: «We had more thorough safety testing when the technology was less powerful. That’s a recipe for disaster.» But safety, it seems, is no longer the word of the day. In Washington, the Trump administration has made it clear: regulation must not slow down innovation. Silicon Valley’s response was unanimous—clear the path. OpenAI, Meta, and Google are urging the White House to protect their right to use any publicly available data for training, oppose state-level regulation, and most importantly, move fast. In the words of US Vice-President JD Vance: “The AI future will not be won by hand-wringing over safety.” Welcome to the era of AI security. In February, the UK’s AI Safety Institute quietly rebranded itself as the AI Security Institute—reflecting a broader shift. The conversation is no longer about social impact, ethics, or fairness. It’s about national competitiveness, cyberwarfare, and geopolitical threats. There is still no global standard for AI safety evaluations, and while the EU AI Act will soon require formal testing for high-risk systems, most companies continue to rely on voluntary commitments and self-policing protocols. The irony is painful: companies that once called for caution are now speeding towards Artificial General Intelligence, downplaying risk while raising billions. Elon Musk, who supported a development pause in 2023, launched xAI months later and raised $12 billion to join the race. Meanwhile, real-world data is beginning to show the costs: an MIT Media Lab study found that heavy use of AI chatbots correlates with increased loneliness, dependence, and reduced social interaction. The question now is not whether AI companies care about safety. It’s whether the public and policymakers are willing to demand more than reassurances from the very firms racing to reshape civilisation.

Cómo la IA Está Transformando la Seguridad Energética en el Reino Unido

Descubre cómo el Reino Unido utiliza la IA para optimizar las energías renovables, mejorar la resiliencia de la red y alcanzar objetivos de seguridad energética y sostenibilidad.

Jeffrey Katzenberg sobre el impacto de la IA en Hollywood

El cofundador de DreamWorks, Jeffrey Katzenberg, explica cómo la IA está revolucionando Hollywood, potenciando la creatividad y optimizando los procesos de producción.